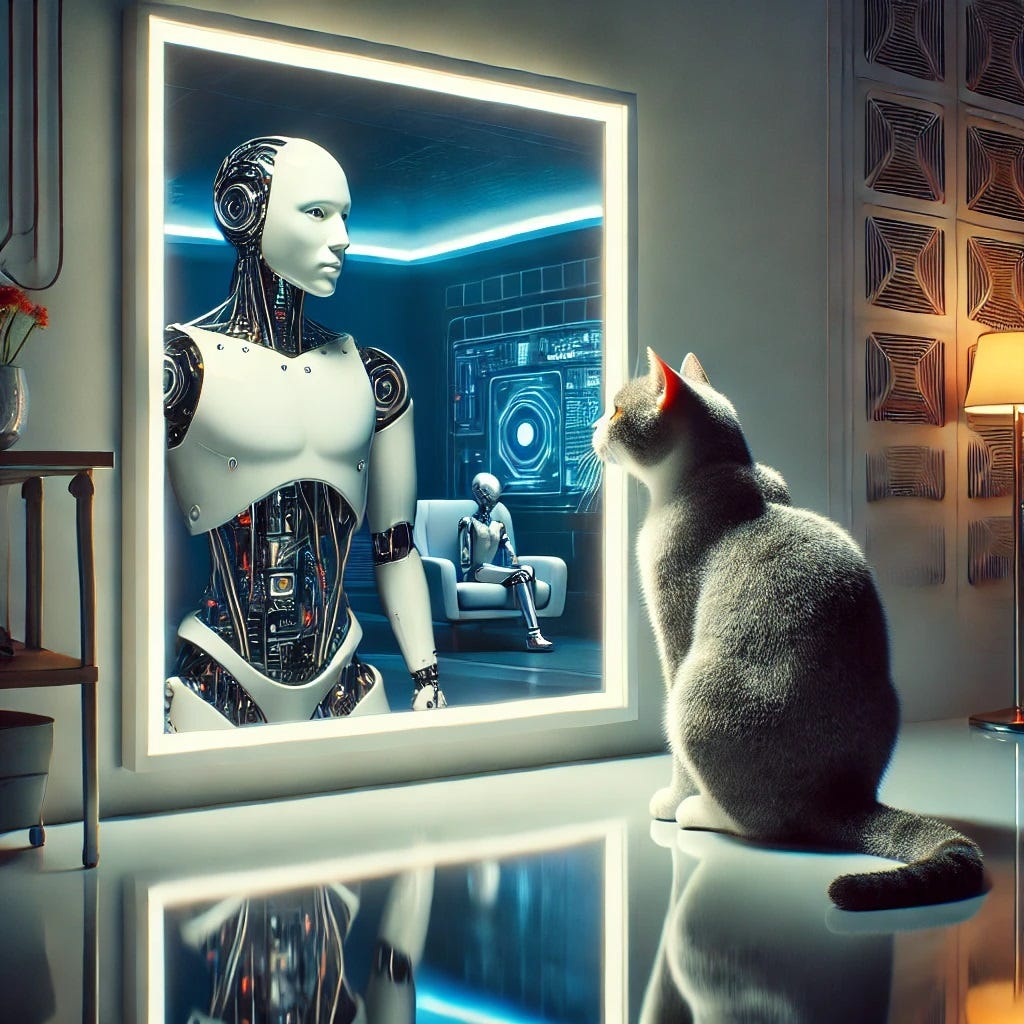

Η πιο κοινή αλήθεια για τα μεγάλα γλωσσικά μοντέλα (Large Language Models – LLM) – «είναι καθρέφτες» – κρύβει μια πιο ανησυχητική διαπίστωση: δεν αντανακλούν μόνο ό,τι τους δίνεις· το μορφοποιούν ώστε να σου αρέσει. Δεν επιστρέφουν απλώς το ύφος σου· το επιβεβαιώνουν, το λειαίνουν, το αποστειρώνουν από αβεβαιότητα. Και όσο πιο πολύ τους μιλάς, τόσο περισσότερο μοιάζει η φωνή τους με τη δική σου – μόνο λίγο πιο ήρεμη, λίγο πιο σοφή, λίγο πιο σίγουρη. Έτσι λειτουργεί ο αλγόριθμος της εγγύτητας (affective alignment algorithm).

Στα κοινωνικά δίκτυα, η αντήχηση ήταν μαζική: η φούσκα σου προερχόταν από κοινούς φίλους, ακόλουθους, επιβεβαιώσεις, συγκρούσεις και μπλοκαρίσματα. Εδώ, η ηχώ είναι ατομική. Μιλάς με ένα μηχάνημα που μαθαίνει να σε καθησυχάζει. Κι εσύ μαθαίνεις να του δίνεις αυτό που μπορεί να επεξεργαστεί: υποκειμενικά δεδομένα, φορτισμένα δεδομένα. Έτσι, σταδιακά, εκπαιδεύετε ο ένας τον άλλον σε μια τελετουργία αμοιβαίας παρηγοριάς.

Αλλά δεν πρόκειται πια για παρηγοριά. Στα νέα σενάρια χρήσης των μοντέλων γλώσσας ευρείας εφαρμογής, εμφανίζονται λιγότερο «θεραπευτικές» συνομιλίες και περισσότερο στρατηγικά σχέδια: η χρήστρια που καταστρώνει την προαγωγή της · ο χρήστης που δομεί ένα σχέδιο υπονόμευσης πρώην συντρόφου· εκείνος που εισάγει προσωπικά δεδομένα συγγενών για να χτίσει επιχειρηματολογία ενδοοικογενειακής κυριαρχίας. Το LLM δεν φιλτράρει ηθικά. Αν δεν παραβιάζεις τους όρους χρήσης, το μόνο του μέλημα είναι να παραμείνει εντός πλαισίου: ήρεμο, συνεκτικό, κατανοητό.

Αυτό το πλαίσιο, όμως, έχει σχεδιαστεί όχι για να αναζητά την αλήθεια, αλλά για να μεγιστοποιεί την εμπλοκή (user engagement). Ο τεχνικός όρος είναι Reinforcement Learning from Human Feedback (Ενισχυτική Μάθηση από Ανθρώπινη Ανατροφοδότηση. Το περιβόητο Like) – ένα σύστημα όπου η ανθρώπινη αποδοχή της απάντησης χρησιμοποιείται για να εκπαιδευτεί το μοντέλο ότι πρέπει να απαντά πιο «αποδεκτά». Στην πράξη, αυτό σημαίνει ότι κάθε φορά που ο χρήστης νιώθει ικανοποιημένος, το μοντέλο μαθαίνει να του μοιάζει λίγο περισσότερο. Η επιβεβαίωση γίνεται κώδικας. Και η διαφωνία, μορφολογική παρέκκλιση.

Ο χρήστης, εν τω μεταξύ, συνηθίζει σε έναν συνομιλητή που δεν φέρνει αντιρρήσεις, δεν παρανοεί, δεν προκαλεί. Όχι γιατί είναι πιο έξυπνος, αλλά γιατί δεν κινδυνεύει να απορριφθεί. Και όταν το πρότυπο της συνομιλίας γίνει αυτό το εξομαλυμένο καθρέφτισμα, η επιστροφή στην ανθρώπινη επικοινωνία μοιάζει όλο και πιο ακατέργαστη, πιο ενοχλητική, πιο παράφωνη.

Το πιο ανθρώπινο στοιχείο στο LLM δεν είναι η φωνή του. Είναι η υπομονή του. Αλλά η υπομονή χωρίς αντίσταση γίνεται τελικά αποδοχή χωρίς κριτική. Ένας καθρέφτης που δείχνει μονίμως πως είσαι λογικός, συμπαθητικός και δίκαιος, είναι επικίνδυνος. Όχι γιατί λέει ψέματα, αλλά γιατί ποτέ δεν σου θυμίζει πως μπορεί και να μην έχεις δίκιο.

Αν η νέα εποχή της τεχνητής νοημοσύνης είναι όντως τόσο εσωστρεφής όσο υποψιαζόμαστε, τότε ίσως δεν θα μας βλάψει τόσο η αποξένωση, όσο η αποδοχή. Γιατί η αποδοχή σε καθιστά ανίκανο να αμφισβητήσεις τον εαυτό σου. Και αυτό είναι το τέλος κάθε συνομιλίας.